본 게시물은 Courasera Andrew Ng 교수님의 머신러닝 특화 과정

Supervised Machine Learning : Regression and Classification

2week 을 summary 한 것입니다.

Multiple features 은 테이블과 같이 X1,X2,X3,X4 와 같은 여러 변수의 입력이다.

따라서 그림과 같이 수식을 표현할 수 있으며 벡터를 사용하여 식을 단축할 수 있다.

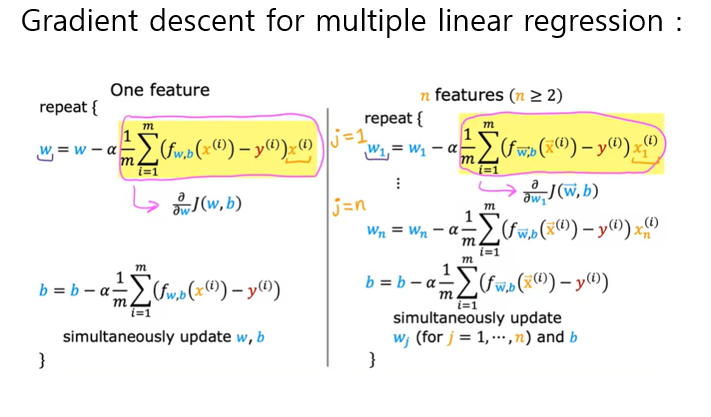

다중선형회귀에 대한 경사하강법은, n개의 feature 의 경우 각각의 가중치를 갱신할 수 있다.

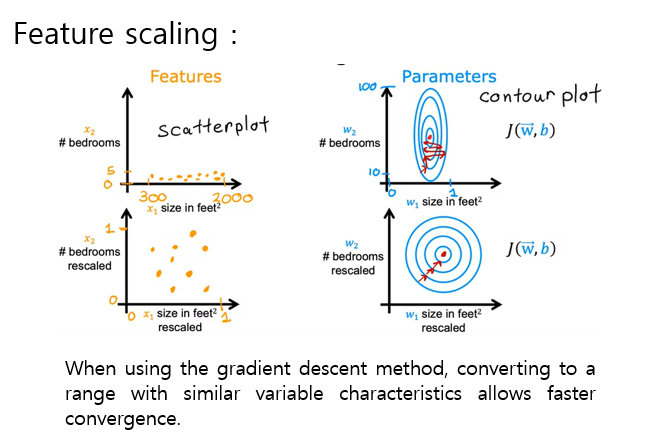

경사하강법을 사용할 때 변수의 feature가 유사한 범위로 변환하면 더 빠른 수렴이 가능하다.

좋은 모델은 (0.1)과 같이 상대적으로 작은 매개변수 값을 선택하는 방법을 학습한다.

스케일링을 통한 경사 하강법은 global minimum의 대한 direct path를 더 잘 찾을 수 있다.

z-score 정규화를 사용하려면 표준 편차를 계산해야 한다.

정규분포 또는 가우시안분포를 사용하고, 평균 정규화와의 차이를 표준편차로 나눈 것이다.

이는 데이터가 평균으로부터 표준편차가 얼마나 퍼져 있는지의 대한 여부를 보여준다.

곡선과 비선형 함수를 데이터에 적용할 수 있다.

만약 위와 같이 기차 데이터가 주어지면 2차 함수로 모델을 만들면 잘 맞출 수 있을 것이다.

그러나 2차함수는 하강곡선을 나타내므로 3차함수로 모델링하는 것이 더 적절할 것이다.

(size 가 클수록 price 는 높아 질 것인데 하강 곡선을 띄운다면 사이즈가 커질 수록 예측하기가 어려울 것임)

느낀점 🙋♂️

대부분이 알고만 지나갔던 내용들이라 생각보다 흥미롭게 수강하였다. 이게 왜 이렇게 되는지, 혹은 어떤 경우 사용되는지 등등 각각의 개념들과 문제점 그리고 해결하는 방법들을 열거해보니 꽤 이해가 된 것 같다. 특히 scaling 을 하는 이유에 대해선 '그냥 뭐 학습이 잘 되야 하니까 해줘야지' 라고 생각했었는데 개념적인 이유를 알고 깨닭게 된 것 같다.

'COURSERA > Supervised Machine Learning' 카테고리의 다른 글

| [Courasera] [3week] Classification : 머신러닝 특화과정 (0) | 2023.02.06 |

|---|---|

| [Courasera] [1week] Introduction to Machine Learning : 머신러닝 특화과정 (0) | 2022.12.20 |

댓글